En la era digital, la inteligencia artificial (IA) está jugando un rol cada vez más prominente en la política, pero no siempre de manera positiva. Un caso reciente en Ecuador pone de relieve los riesgos de la tecnología en los procesos democráticos, cuando se usa para manipular y distorsionar la realidad.

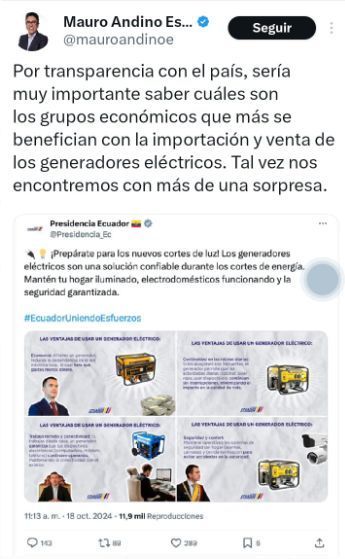

Como antecedente a mediados de octubre de 2024, empezó a circular un montaje usando la cuenta de la presidencia en X en la que incluían fotos del presidente y se promovía el uso de generadores eléctricos ante la crisis energética que vive el país, un X que núnca fue publicado en la cuenta de la presidencia.

Aunque algunos personajes afines al correismo hicieron eco de esta información en la misma red, era fácilmente identificable que se trataba de información alterada, ya que en la parte inferior aparecía la palabra «Reproducciones», mientras que en X se utiliza el término «Visualizaciones», independientemente de si se trata de video o fotos. Pero no importa si es o no verdad, lo que importa es que los contenidos que difunden reafirmen sus puntos de vista y hagan el mayor daño posible cuando se trata de afectar a los adversarios políticos.

El 21 de octubre comenzó a circular un extracto de una entrevista al ministro Arturo Félix Wong, realizada el 4 de octubre en Radio Sucesos, es decir, dos semanas antes. En el video, el ministro supuestamente hacía unas declaraciones que rápidamente generaron controversia: “Yo no tengo la culpa de que la gente no se compre su propio generador eléctrico, o ¿quieren que el presidente les regale un generador?”, cosas que nunca dijo como se puede revisar en el minuto 15 de la entrevista que es el alterado con un una técnica de deepvoice, aqui se puede revisar la entrevista completa:

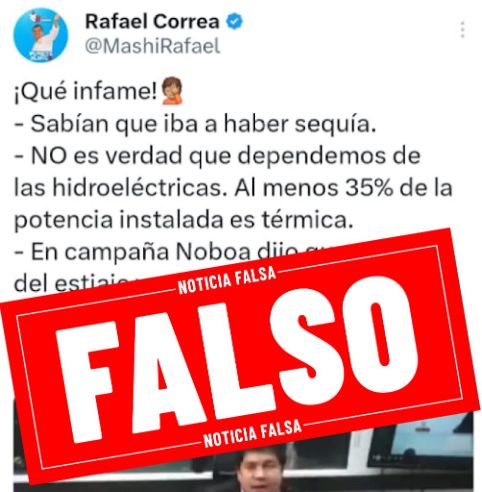

El video abajo presentado con la alteración apareció en plataformas alineadas con el correísmo, y la cuenta del propio expresidente Rafael Correa, @mashirafael, se convirtió en la principal difusora de este contenido manipulado, volviéndolo viral en redes sociales.

Este comportamiento de no verificación, difusión de noticias falsas y deepfakes con IA contribuye a la polarización política y a la desinformación en el país. Aunque Correa sigue gozando de una amplia base de seguidores, el uso de estas tácticas pone en evidencia los riesgos que conlleva la manipulación digital en el ámbito electoral. La facilidad con la que se puede crear contenido falso y distribuirlo masivamente en redes sociales como X, donde Correa tiene una gran presencia, y con sus publicaciones exacerba la situación.

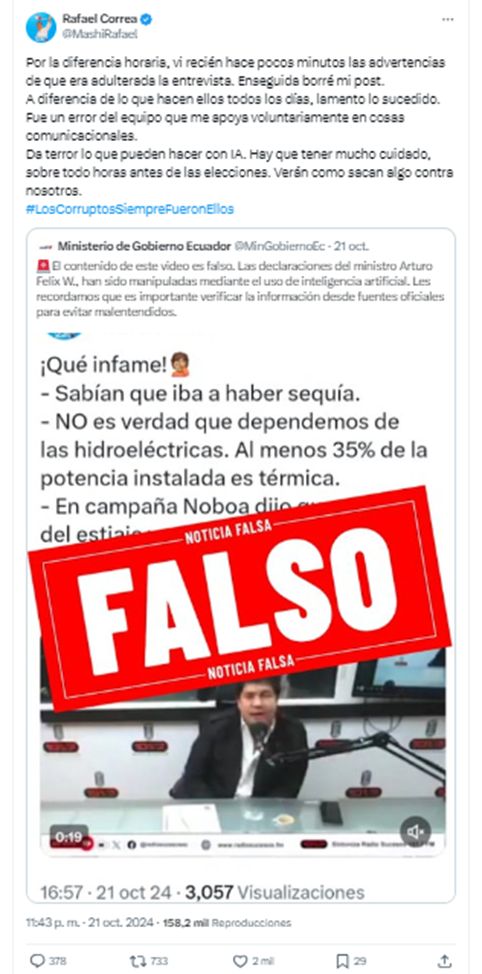

El mismo día por la tarde, el Ministerio de Gobierno denunció la manipulación de este video y su audio. Según el pronunciamiento en X de dicho ministerio, la información había sido alterada deliberadamente para distorsionar las declaraciones del ministro, sugiriendo que sus palabras transmitían un mensaje completamente diferente al original.

Este tipo de contenidos realizados con IA, especialmente en un contexto político tan delicado como el actual, están diseñados para dañar la imagen y percepción del actual presidente, especialmente a las puertas de las elecciones de 2025 en las que aspira a una reelección.

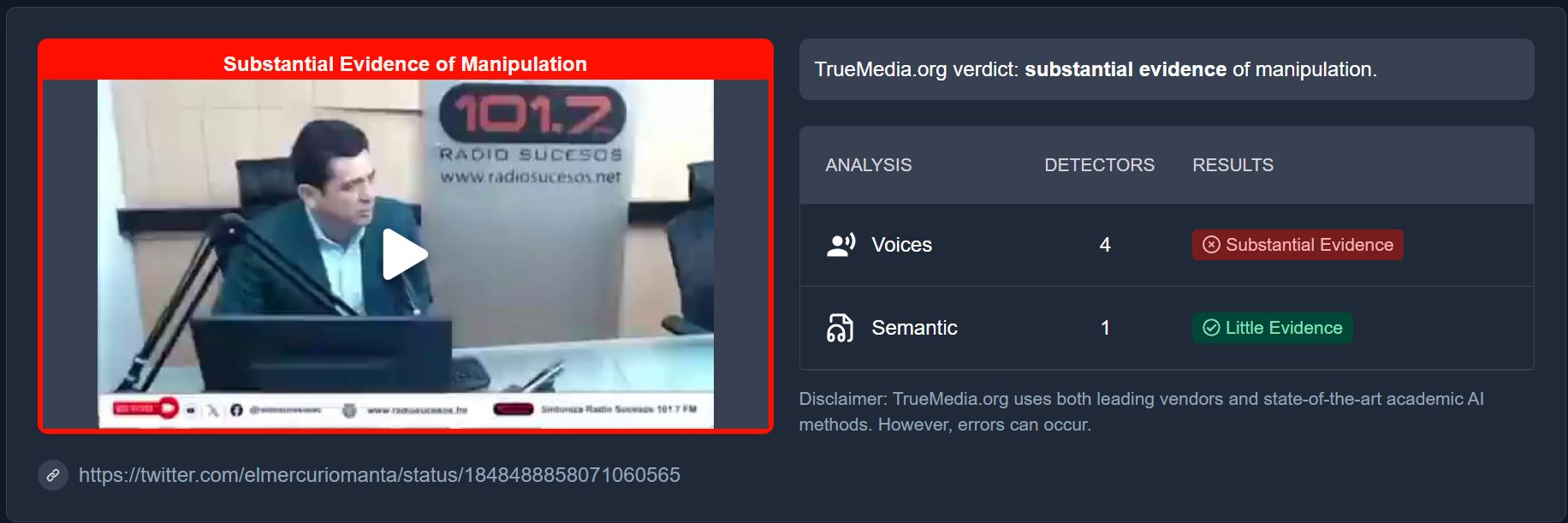

Después de que varios portales de verificación y personas que revisaron la entrevista completa denunciaran que se trataba de un deepvoice, Lupa Media en un post en X señaló que: “Un análisis de autenticidad del audio muestra que existen evidencias sustanciales de que fue generado mediante inteligencia artificial”.

Milton Pérez confirmó a Ecuador Chequea que «eso es un montaje, el ministro no dijo eso», y señaló que probablemente se esté utilizando la imagen de Arturo Félix Wong con el fin de perjudicar al Gobierno.

Radio Sucesos denunció a través de su cuenta en X «la circulación de un audio alterado mediante inteligencia artificial, manipulado a partir de una entrevista con el Ministro de Gobierno».

A Correa no le quedó más que reconocer que se trataba de un contenido falso y que lo eliminaba, con la excusa de: “Por la diferencia horaria, vi recién hace pocos minutos las advertencias de que era adulterada la entrevista. Enseguida borré mi post. A diferencia de lo que hacen ellos todos los días, lamento lo sucedido. Fue un error del equipo que me apoya voluntariamente en cosas comunicacionales”.

Y destaca en la parte final lo que la IA puede hacer en la actualidad, especialmente en época electoral: “Da terror lo que pueden hacer con IA. Hay que tener mucho cuidado, sobre todo horas antes de las elecciones. Verán cómo sacan algo contra nosotros.”

Sin embargo, hay cuentas que postearon este contenido y, a pesar de que varios medios de comunicación han publicado que se trata de información falsa generada con IA, como La Hora, Extra, Expreso, y portales de verificación de datos como Ecuador Chequea o Lupa Media, no han eliminado sus publicaciones, con la clara intención de dejarlas en redes para seguir afectando la percepción sobre este tema.

Hicimos nuestra propia verificación con el video en la página truemedia.org para detectar información falsa o generada por la IA y obtuvimos el siguiente resultado: 69% de confianza que el audio fue generado por IA, y 67% de confianza sobre la falta de autenticidad del audio. Conclusión: SUSTANCIAL EVIDENCIA DE MANIPULACIÓN.

El uso de IA para crear audios y videos falsos, conocidos como «deepfakes», está planteando serios problemas para la democracia. Estas herramientas permiten modificar discursos, alterar la apariencia de personas en videos y difundir contenidos que, a simple vista, parecen auténticos. Este tipo de manipulación no solo distorsiona la verdad, sino que también puede influir de manera directa en la opinión pública y afectar los resultados electorales.

En redes sociales como X (antes Twitter), el impacto de estas falsificaciones es aún más visible. La viralización de este tipo de contenidos es rápida y puede sembrar confusión entre los votantes, quienes muchas veces no cuentan con las herramientas necesarias para distinguir entre lo real y lo manipulado.

La preocupación por el uso de IA en el ámbito político no es nueva, pero este caso en Ecuador ha encendido las alarmas sobre cómo esta tecnología puede ser usada con fines malintencionados. Desde posts falsificados hasta videos que distorsionan la realidad, los peligros de la IA son claros: la desinformación puede manipular la percepción pública, generar desconfianza en los candidatos y socavar la integridad del proceso democrático.

Ante esta situación, hacemos un llamado a usar herramientas de verificación de información, además de impulsar la educación digital entre la población. Asimismo, se plantea la necesidad de establecer regulaciones más estrictas para evitar el uso indebido de la IA en campañas políticas y asegurar que los procesos electorales se lleven a cabo de manera justa y transparente.

En un contexto electoral cada vez más digitalizado, la inteligencia artificial se está convirtiendo en un arma de doble filo. Si bien tiene el potencial de mejorar la comunicación y optimizar las campañas, también puede ser utilizada para engañar, manipular y alterar la voluntad popular. El desafío ahora es equilibrar los beneficios tecnológicos con la protección de la democracia.

José Rivera Costales PhD.